AI 토큰은 ChatGPT 같은 AI 모델이 문장을 읽을 때 사용하는 단위다. 우리가 보는 글자를 그대로 읽는 게 아니라, 단어와 문자 묶음을 잘게 나눠 처리한다. 한국어는 영어보다 2~3배 더 많은 토큰을 쓰는 경우가 많아서, 같은 질문이라도 한국어 사용자가 비용과 속도 면에서 더 불리해질 수 있다.

GPT-3 가 처음 나왔을 때는 한국어 프롬프트 품질이 지금보다 훨씬 불안정했다. 그래서 프롬프트를 영어로 번역해 주는 크롬 익스텐션을 깔고 한국어 입력을 영어로 바꿔 보내는 사람이 많았는데, 나도 그 중 하나였다. 같은 질문인데 영어로 보내면 답이 더 깔끔하게 나왔다. 나중에 알고 보니 그 차이의 상당 부분이 토큰 구조와 연결돼 있었다.

AI 토큰은 글자를 작게 쪼갠 조각

자주 쓰는 표현은 통째로, 낯선 표현은 잘게 쪼개는 방식

AI 모델이 글자를 처리할 때는 한 글자씩 보는 게 아니다. 자주 등장한 단어 묶음은 통째로 한 토큰, 처음 보거나 드문 표현은 더 잘게 쪼개진다.

영어로 보면 ‘the’, ‘of’, ‘and’, ‘hello’ 같은 흔한 단어는 보통 1토큰이다. 반면 ‘antidisestablishmentarianism’ 같이 길고 드문 단어는 여러 조각으로 나뉘어 네다섯 토큰 이상을 차지할 수 있다.

이런 분할 방식은 모델이 학습 과정에서 자주 등장한 글자 묶음을 기억하면서 만들어진다. 식료품점에서 자주 팔리는 상품은 묶음 포장으로 두고, 드물게 팔리는 상품은 낱개로 두는 방식과 비슷하다.

결과적으로 자주 쓰는 표현은 가볍고, 드문 표현은 무겁다. 같은 의미를 전달해도 어떤 단어를 쓰느냐에 따라 토큰 수가 크게 달라질 수 있다.

영어 네 글자 정도가 평균 한 토큰

OpenAI 공식 안내에 따르면 영어 텍스트는 약 4글자가 평균 1토큰에 해당한다. (출처) 짧은 단어인 ‘hi’, ‘go’ 같은 경우는 1토큰으로 끝나고, ‘hello world!’ 처럼 흔한 표현도 두세 토큰이면 충분하다.

물론 이 기준은 모델마다 조금씩 다르다. GPT-3 시절 토크나이저는 영어에 훨씬 강하게 최적화돼 있었고, 이후 다국어 학습 비중이 늘어나면서 분할 방식도 계속 바뀌었다. 그래도 영어 4글자 정도가 1토큰이라는 감각은 입문자가 이해하기 좋은 기준이다.

이 감각만 있어도 대략적인 분량 계산이 가능하다. 5,000자짜리 영어 문서는 약 1,250토큰 정도로 어림할 수 있고, 16,000자 분량의 영어 책 챕터는 대략 4,000토큰 안팎이다.

토큰 단위로 이해하는 모델

AI 모델은 우리가 입력한 문장을 글자가 아니라 토큰 ID 의 숫자 배열로 변환해 처리한다. “Hello, world!” 같은 문장도 모델 안에서는 숫자 목록으로 바뀌어 들어간다.

그 뒤 모델은 다음에 올 토큰을 하나씩 예측하면서 답변을 만든다. 마지막 단계에서만 다시 사람이 읽는 글자로 바뀌어 화면에 출력된다.

우리가 보는 자연스러운 문장은 결국 토큰, 숫자, 모델 계산을 거쳐 다시 글자로 돌아오는 과정을 통해 만들어지는 셈이다. 그래서 모델 입장에서 글자는 결과물에 가깝고, 실제 작업 단위는 항상 토큰이다.

같은 말을 한국어로 쓰면 토큰이 2~3배

자모와 어미 때문에 더 잘게 분해되는 한글

한글은 자음과 모음을 조합해 글자를 만드는 구조다. ‘가’ 한 글자도 내부적으로는 ‘ㄱ’ 과 ‘ㅏ’ 의 조합이고, 받침까지 들어가면 구조가 더 복잡해진다.

초기 GPT 계열 토크나이저에서는 한글이 지나치게 잘게 분해되는 사례가 자주 보고됐다. 한 분석 글에서는 GPT-3 토크나이저가 한글 12자를 36토큰으로 처리한다는 측정도 소개됐다. (출처) 영어 중심 데이터로 학습된 모델일수록 한글을 익숙하게 처리하지 못했고, 그 결과 토큰 수가 비정상적으로 늘어나는 경우가 있었다.

여기에 한국어 특유의 어미 변화도 영향을 준다. ‘먹는다’, ‘먹었다’, ‘먹겠습니다’ 처럼 어근 하나에서 형태가 계속 바뀌면 토크나이저 입장에서는 같은 단어를 여러 방식으로 처리해야 한다.

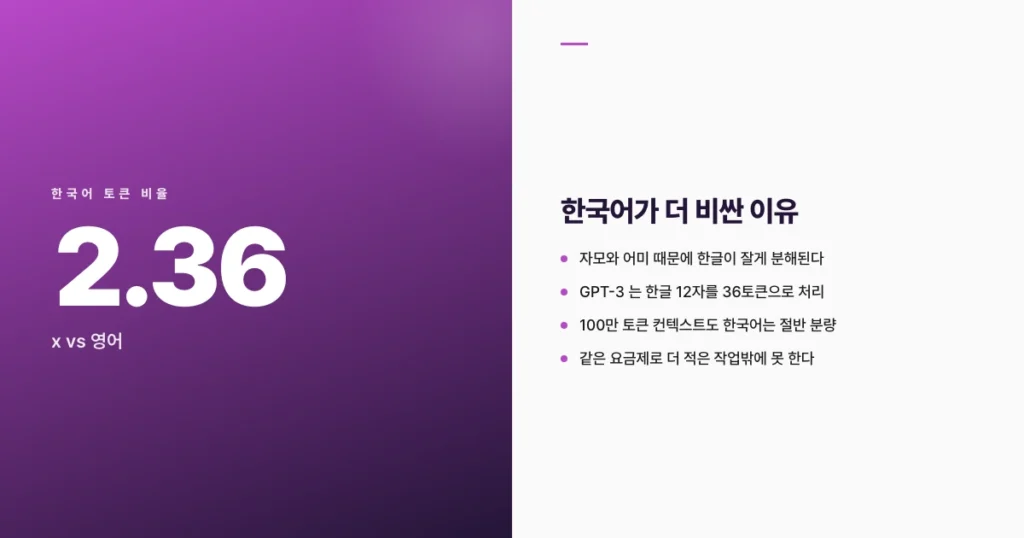

영어 대비 2.36배라는 한국어 토큰 벤치

여러 비교 실험에서 한국어가 영어보다 훨씬 비효율적으로 토큰화되는 결과가 반복해서 나온다.

한 정량 비교 글에서는 같은 의미 문장을 여러 언어로 번역해 토큰 수를 측정했을 때, 한국어가 영어 대비 평균 2.36배 수준의 토큰을 사용했다는 결과가 소개됐다. 일본어는 2.12배, 중국어는 1.76배 수준이었다. (출처)

다른 사례에서도 “오늘 서울 날씨 알려줘” 같은 짧은 문장이 영어보다 훨씬 많은 토큰을 차지하는 경우가 보고됐다. (출처) 벤치마다 수치는 조금씩 다르지만 방향은 거의 비슷하다. 한국어는 영어보다 더 많은 토큰을 쓰는 편이다.

한국어 사용자가 모르고 내는 추가 비용

이 차이는 실제 비용과 속도로 이어진다. 같은 분량의 책을 한국어로 요약시키면 영어 원문보다 훨씬 많은 토큰을 쓰게 되고, API 요금도 그만큼 더 올라간다.

컨텍스트 한도에도 영향을 준다. 100만 토큰 컨텍스트 모델이라도 한국어로 입력하면 영어 대비 훨씬 적은 양의 문서만 넣을 수 있다. 같은 책 한 권을 다루더라도 한국어 사용자가 더 빨리 한도에 부딪히는 셈이다.

대부분 사용자는 토큰 수를 직접 보지 않기 때문에 이런 차이를 체감하지 못한다. 같은 요금제를 써도 실제로 처리 가능한 작업량은 영어 사용자보다 적을 수 있다.

토큰 때문에 생기는 AI의 이상한 실수들

ChatGPT가 자기 답변 글자 수를 잘 못 세는 이유

GPT-3 시절 ChatGPT 에게 “500자 미만으로 답변해 줘” 라고 요청하면 분량이 자주 들쭉날쭉했다. 글자 수를 맞춰 달라고 다시 요청해도 결과는 크게 다르지 않았다.

이유는 단순하다. 모델은 글자가 아니라 토큰 단위로 답변을 만든다. 자기가 출력한 결과를 다시 글자 단위로 정확히 세는 작업은 생각보다 약한 편이다. 그래서 글자 수 제한, 문장 길이 제한 같은 요청은 지금도 종종 어긋난다.

strawberry의 r 개수를 틀리는 같은 원리

한동안 인터넷에서 화제가 됐던 질문이 있다.

“strawberry 안에 r 이 몇 개야?”

사람은 금방 셀 수 있지만 AI 는 종종 틀린 답을 내놓는다.

이유는 비슷하다. 모델은 strawberry 를 사람처럼 글자 하나씩 읽는 게 아니라, 몇 개의 토큰 묶음으로 처리한다. 그래서 내부 글자 구성을 정확히 세는 작업에 약하다.

토큰 기반 모델은 의미 이해에는 강하지만, 문자 단위 계산에는 의외로 취약한 경우가 많다.

프롬프트를 영어로 번역하던 우회법

GPT-3 초기에는 같은 질문이라도 한국어보다 영어 프롬프트의 품질이 훨씬 안정적인 경우가 많았다. 그래서 한국어 입력을 영어로 번역해 보내는 우회법도 꽤 유명했고, 나도 한동안 그 익스텐션을 깔아 두고 썼다.

당시엔 영어 쪽이 훨씬 안정적이었다. 토큰 효율도 좋았고, 학습 데이터 양 자체가 달랐다.

한국어를 영어로 바꾸면 토큰 수가 줄어 컨텍스트 여유가 생겼고, 모델도 더 자연스럽게 답하는 경우가 많았다.

요즘 모델은 다국어 성능이 많이 좋아졌지만, 긴 문맥을 다룰 때는 여전히 영어가 유리하다는 이야기가 자주 나온다.

AI 토큰 구조가 만든 비용과 한계

토큰은 AI 가 글자를 보는 자기만의 단위다. 모델은 우리가 입력한 글을 토큰으로 잘게 자르고, 그 토큰 시퀀스를 보고 다음 토큰을 예측해 답을 만든다.

이 구조에서 한국어는 영어보다 평균 2~3배 토큰을 쓴다. 같은 질문이라도 한국어 사용자는 비용을 더 내고 한도에 더 빨리 부딪힌다. 모델이 글자 수나 strawberry 의 r 같은 글자 단위 작업에 약한 이유도 같은 자리에서 나온다.

토큰 한 단어를 알면 AI 의 비용, 한도, 실수 패턴이 한 줄로 꿰어진다. 한국어 사용자라면 이 차이를 인지하고 쓰는 것만으로도 적지 않은 손해를 줄일 수 있다.