AI와 그래픽카드는 떼려야 뗄 수 없다. AI 학습과 추론의 핵심이 거대한 행렬 곱셈이라, 같은 계산을 수천 개씩 병렬 처리하는 GPU가 CPU보다 압도적으로 유리하다. 2026년 현재 글로벌 AI GPU 주문량은 200만 장을 넘었지만 공급은 70만 장 수준이다.

나는 AI와 그래픽카드의 관계를 설명할 때마다 “왜 GPU가 이렇게 부족한데?”라는 질문을 받는다. 엔비디아 최신 칩은 빅테크가 선점하고, 한국도 같은 확보 경쟁에 뛰어든 상황이다. 이를 자세히 정리해본다.

AI 가 GPU 를 필요로 하는 이유

뛰어난 일꾼 몇 명, 일반 일꾼 수천 명

CPU와 GPU의 차이는 사람에 비유하면 이해하기 쉽다. CPU는 복잡한 문제를 빠르게 해결하는 숙련된 전문가 몇 명에 가깝다. 반면 GPU는 단순한 작업을 동시에 처리하는 작업자 수천 명이 함께 움직이는 구조다.

GPU의 코어 하나하나는 CPU보다 단순하지만 수가 압도적으로 많다. 그래서 같은 계산을 반복적으로 처리해야 하는 AI 작업에서는 GPU가 훨씬 효율적이다.

같은 행렬 연산을 한꺼번에 처리하는 병렬 구조

AI 학습은 같은 행렬 연산을 수없이 반복하는 작업이다. 이런 계산은 서로 독립적으로 수행할 수 있기 때문에 GPU의 병렬 구조와 잘 맞는다.

예를 들어 행렬의 특정 위치 계산은 다른 위치 계산 결과를 기다릴 필요가 없다. GPU는 이런 작업을 동시에 수천 개씩 처리할 수 있도록 설계돼 있다. 반대로 CPU는 순차 처리에 강한 구조라 대규모 AI 학습에서는 속도 차이가 크게 벌어진다.

메모리 대역폭에서도 따라갈 수 없는 격차

연산 성능만 중요한 것도 아니다. AI 모델은 학습 과정에서 막대한 데이터를 메모리와 연산 코어 사이에서 계속 주고받는다. 이때 메모리 대역폭이 좁으면 GPU 코어가 데이터를 기다리느라 성능을 제대로 내지 못한다.

일반적인 비교에서 GPU의 메모리 대역폭은 약 300GB/s 수준이고, CPU는 50GB/s 안팎이다. 6배에 가까운 격차다. 최신 데이터센터 GPU는 HBM3, HBM3e 같은 고속 메모리를 사용해 초당 1TB가 넘는 데이터 처리 속도를 지원하기도 한다. (출처)

연산 코어와 메모리 양쪽이 모두 빨라야 AI 학습이 제대로 돌아간다. GPU는 이 두 축을 한꺼번에 키운 하드웨어라서 AI 시대의 표준이 됐다.

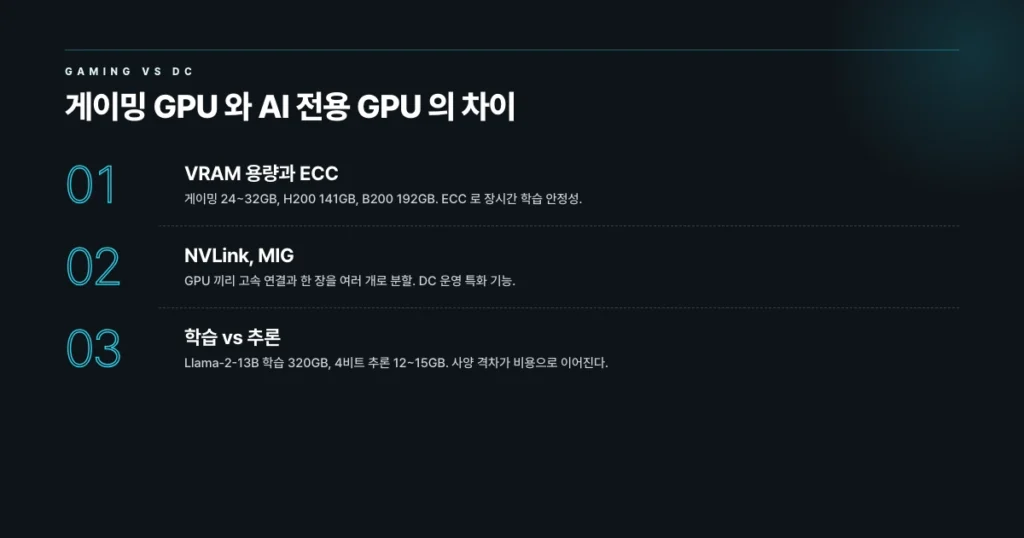

게이밍 GPU 와 AI 전용 GPU 의 차이

목적의 차이

같은 GPU라도 RTX 5090 같은 게이밍 GPU와 H200 같은 데이터센터 GPU는 목적 자체가 다르다. 게이밍 GPU는 개인 사용 환경에 맞춰져 있지만, 데이터센터 GPU는 대규모 AI 학습과 서버 운영을 전제로 설계된다. AI와 그래픽카드 사이에서 어떤 등급을 고르느냐에 따라 비용도 성능도 달라진다.

VRAM 용량과 ECC 메모리

대표적인 차이가 VRAM 용량이다. 게이밍 GPU는 일반적으로 24~32GB 수준이지만, 데이터센터 GPU는 80GB 이상이 기본이다. H200은 141GB, 차세대 B200은 192GB 수준까지 올라간다. AI 모델 규모가 커질수록 VRAM 용량이 곧 성능과 직결된다.

데이터센터 GPU에는 ECC 메모리도 기본 탑재된다. ECC는 메모리 오류를 자동으로 감지하고 수정하는 기능이다. AI 학습은 며칠에서 몇 주씩 계속되는 경우가 많다. 이 과정에서 단 한 번의 메모리 오류도 학습 결과 전체를 망칠 수 있기 때문에 안정성이 매우 중요하다.

NVLink, MIG 같은 데이터센터 특화 기능

또 다른 차이는 NVLink와 MIG 같은 데이터센터 기능이다.

NVLink는 여러 GPU를 초고속으로 연결하는 기술이다. AI 학습에서는 GPU 여러 장을 동시에 묶어 사용하는 경우가 많기 때문에 GPU 간 데이터 전송 속도가 중요하다.

MIG는 하나의 GPU를 여러 개의 가상 GPU처럼 나눠 쓰는 기능이다. 클라우드 환경에서 여러 사용자가 GPU 자원을 효율적으로 공유할 수 있게 해준다.

이런 기능은 개인용 게이밍 환경에서는 크게 필요하지 않기 때문에 일반 GPU에는 대부분 포함되지 않는다.

학습은 VRAM 많이, 추론은 적게 쓰는 차이

같은 AI 모델이라도 학습과 추론은 필요한 GPU 사양이 다르다.

학습은 모델 가중치뿐 아니라 입력 데이터, 그라디언트, 옵티마이저 상태까지 모두 VRAM에 올라가야 한다. 예를 들어 Llama-2-13B 같은 모델을 전체 파라미터 미세조정하려면 320GB 가량의 VRAM이 필요하다는 보고가 있다. A100 80GB 카드 4장을 묶어야 가까스로 가능한 수준이다. (출처)

반면 추론은 이미 학습된 모델을 실행만 하면 되기 때문에 상대적으로 가볍다. 같은 13B 모델도 4비트 양자화 후 추론할 때는 12~15GB 면 충분하다.

이 차이를 이해하지 못하면 불필요하게 고가 GPU를 구매하는 경우도 많다.

2026년 GPU 부족 현상과 한국 상황

주문 200만 장, 공급 70만 장

2026년 2월 기준 글로벌 AI 데이터센터 GPU 주문은 약 200만 장에 달했지만, 실제 확보 가능한 물량은 70만 장 수준에 그쳤다. 주문의 3분의 2 가량이 제때 공급되지 못한다는 의미다.

AI 기업들이 경쟁적으로 데이터센터를 늘리면서 GPU 수요가 폭발적으로 증가했지만, 생산량은 이를 따라가지 못하고 있다. 특히 TSMC 첨단 공정, HBM 메모리, 패키징 공정까지 병목이 겹치면서 공급 부족이 장기화되고 있다.

빅테크가 H200, B200 싹쓸이

부족한 GPU 물량은 결국 자본력이 큰 빅테크 기업으로 먼저 흘러간다.

마이크로소프트, 메타, 구글, 아마존 같은 기업들은 수십만 장 단위로 GPU를 선주문하고 있다. 반면 스타트업이나 중소 규모 AI 기업은 정상 가격에 GPU를 확보하기조차 어려워졌다.

샘 알트먼은 GPT-출시를 앞두고 “플러스와 프로 버전을 동시에 내놓고 싶었지만 GPU가 부족하다” 고 언급한 바 있다. 오픈AI 같은 곳도 충분한 GPU를 받지 못하는 상황이라는 뜻이다.

한국 AI 주권과 GPU 확보 경쟁

한국 역시 같은 문제를 겪고 있다.

정부와 대기업이 AI 인프라 확대를 위해 GPU 확보 경쟁에 뛰어들고 있지만, 글로벌 공급 부족 상황에서는 원하는 시점에 물량을 확보하기 쉽지 않다.

한국어 학습 데이터 부족과 GPU 부족이 맞물리면서 소버린 AI 모델 구축이 더 어려워졌다는 분석도 나온다. 결국 AI 시대에는 소프트웨어뿐 아니라 GPU 같은 인프라를 얼마나 안정적으로 확보하느냐도 중요한 경쟁력이 되고 있다. (출처)

AI 시대 그래픽카드가 핵심 인프라가 된 흐름

그래픽카드는 단순한 그래픽 처리 부품에서 AI 시대의 핵심 인프라로 자리를 옮겼다. 병렬 연산과 빠른 메모리라는 두 축에서 CPU가 따라잡을 수 없는 격차를 만들었기 때문이다.

게이밍 GPU와 데이터센터 GPU의 차이는 VRAM 용량, ECC 메모리, NVLink, MIG 같은 데이터센터 운영 기능에 있다. 학습은 VRAM을 대량으로 쓰지만 추론은 훨씬 가볍다는 점도 비용 설계의 출발점이다.

여기에 2026년 들어 본격화된 GPU 부족이 겹쳐, AI 시대의 그래픽카드는 이제 사고 싶다고 살 수 있는 부품이 아니다. 빅테크가 선점한 시장에서 한국을 비롯한 후발 주자들의 GPU 확보가 곧 AI 경쟁력의 출발선이 됐다.